Contribution de Dr Ali Kahlane: l’Intelligence artificielle et ChatGPT (Partie 1)

Quand le métier à tisser à bras traditionnel a été remplacé, en 1801 par le métier à tisser mécanisé, les tisserands se sont révoltés et ont saccagé tout ce qui y ressemblait. Cet événement est connu sous le nom de « Luddisme[1]” . Au début du 19ième siècle, ces ouvriers s’opposaient à l’automatisation des métiers à tisser. Ils détruisaient ces machines pour protester contre les changements technologiques qui menaçaient leur emploi et leur mode de vie.

Le mouvement luddite est souvent cité comme exemple de la peur et de la résistance aux changements technologiques et de la manière dont ces changements peuvent avoir des conséquences économiques et sociales importantes pour les emplois. On ne peut pas s’empêcher de faire un parallèle avec deux évènements récents, l’avènement de ChatGPT et sa récente « interdiction”[2] par l’Italie.

Cet article offre un aperçu de l’historique de l’IA depuis les travaux de scientifiques musulmans jusqu’aux modèles de langage actuels tels que GPT-3 et GPT-4. Il examine les progrès de l’Intelligence artificielle (IA) au fil du temps, mettant en lumière les principaux contributeurs et réalisations, tout en abordant les enjeux éthiques associés, notamment l’automatisation, les pertes d’emplois, la vie privée et les biais algorithmiques. L’article met l’accent sur les implications des applications d’IA dans un contexte culturel et religieux, et explore les avancées récentes dans des domaines tels que la défense, les marchés financiers et la recherche, en utilisant l’apprentissage par renforcement et l’apprentissage profond pour résoudre les défis actuels.

Introduction

Le métier à tisser mécanisé dont il était question ci-dessus, était muni de cartes perforées pour réaliser les différents motifs sur le textile. Ces mêmes cartes perforées seront utilisées par les premiers ordinateurs, 120 ans plus tard, popularisées par la compagnie IBM et adoptées dans tous les équipements informatiques, elles seront abandonnées dans les années 1970. Un quart de siècle plus tard, en 1997 Deep blue, une intelligence artificielle, construite par ce même IBM, bat le champion du monde des échecs, Garry Kasparov[3].

L’intelligence artificielle (IA) est un domaine de recherche en informatique qui vise à créer des machines et des programmes capables de réaliser des tâches qui nécessitent normalement l’intelligence humaine. En d’autres termes, l’IA permet aux ordinateurs d’apprendre, de raisonner, de comprendre et d’interagir de manière similaire à la façon dont les humains le font. L’objectif est de faciliter notre vie quotidienne et d’améliorer les performances dans divers domaines, tels que la médecine, la finance, l’industrie et la recherche en général.

L’histoire de l’Intelligence Artificielle

Sans les mathématiques et les algorithmes, il n’y aurait eu point d’IA. Ils sont un élément clé de l’IA et les travaux d’Al-Khawarizmi[4] ont jeté les bases de cette discipline, en contribuant au développement des outils mathématiques nécessaires à la création de systèmes intelligents.

Il est considéré comme le père de l’algèbre et a joué un rôle clé dans le développement des mathématiques, ce qui a finalement contribué à l’essor de l’IA. Ses travaux sur l’algèbre ont conduit au développement de la programmation informatique moderne, qui est à la base de l’IA. Son livre « Al-jabr wa’l-muqabala » a introduit des concepts tels que les équations, les algorithmes et les variables, qui sont fondamentaux pour la résolution de problèmes mathématiques complexes et pour la programmation informatique.

L’autre pilier de l’IA moderne était Al Jazari[5], un ingénieur, un inventeur et un mécanicien célèbre de son temps, qui a conçu de nombreux dispositifs mécaniques sophistiqués, notamment des horloges et des automates. Ses inventions ont influencé le développement ultérieur de la robotique et de l’automatisation, qui ont finalement contribué à l’essor de l’IA.

L’histoire de l’IA moderne remonte à l’époque d’Alan Turing, un mathématicien britannique qui a joué un rôle clé dans le décryptage des codes nazis pendant la Seconde Guerre mondiale[6]. En 1950, Turing a publié un article intitulé « Computing Machinery and Intelligence » dans lequel il a proposé le fameux test de Turing, un critère pour déterminer si une machine peut ou non penser comme un être humain. Le test de Turing consiste à poser des questions à une machine et à évaluer si les réponses sont suffisamment intelligentes pour tromper un humain, en pensant qu’il parle à un autre humain. Un test que les GPT passeraient allégrement aujourd’hui.

En 1956, un groupe de chercheurs en informatique, comprenant John McCarthy, Marvin Minsky, Nathaniel Rochester et Claude Shannon, a organisé une conférence à Dartmouth College pour discuter de l’IA. Cette conférence est souvent considérée comme le point de départ officiel de l’IA en tant que domaine de recherche distinct.

Pendant les années 1950 et 1960, les chercheurs en IA ont développé des programmes informatiques capables de résoudre des problèmes simples tels que la résolution de problèmes mathématiques, la reconnaissance de caractères et l’aide à la prise de décision.

Le manque de puissance des ordinateurs : Le premier “hiver[7]” de l’IA

Dans les années 1970 et 1980, les progrès de l’IA ont été relativement lents, principalement en raison de la complexité des tâches à accomplir et de la difficulté à obtenir des ordinateurs suffisamment puissants pour gérer de grands ensembles de données dont le stockage et l’accès posaient aussi des problèmes insolubles à l’époque.

Cependant, cette période a vu l’émergence de nouvelles approches pour résoudre les problèmes d’IA, notamment l’apprentissage automatique, la recherche en logique et les systèmes experts[8]. Ces systèmes ont été largement utilisés dans les années 1980 pour automatiser des tâches dans des domaines tels que la médecine, de l’ingénierie et de la finance. Ces systèmes sont basés sur des règles simples qui sont utilisées pour résoudre des problèmes spécifiques comme l’aide au diagnostic médical. Les experts humains sont souvent impliqués dans le développement de ces systèmes pour garantir leur précision.

La recherche en logique a également joué un rôle important dans les développements de l’IA des années 1970 et 1980. Les chercheurs ont exploré des méthodes telles que la programmation logique et la résolution de problèmes pour améliorer la capacité des ordinateurs à effectuer des tâches d’IA.

Dans les années 1990, l’IA a connu un renouveau grâce à la montée en puissance des ordinateurs et à l’essor d’Internet. Cette période a vu l’émergence de nouveaux domaines de recherche, tels que l’apprentissage profond[9] et les réseaux neuronaux[10]. Ces réseaux sont modélisés sur le cerveau humain et sont capables d’apprendre des caractéristiques à plusieurs niveaux de complexité. Cette approche a été utilisée pour améliorer la reconnaissance vocale, la classification d’images et la traduction automatique.

Figure N°1 : Historique de l’intelligence artificielle.

Le manque de financements : le deuxième “hiver” de l’IA

Au tournant du millénaire, l’IA a connu un autre « hiver » avec un manque de financement et de progrès, mais avec l’avènement d’Internet et des ordinateurs plus puissants, la recherche en IA a rebondi. Au cours de la décennie suivante, il y a eu des avancées significatives dans les réseaux neuronaux profonds, les systèmes experts, la robotique et l’accessibilité des outils d’IA. Ces avancées ont permis des améliorations dans la reconnaissance d’images, la reconnaissance vocale, la production industrielle, la chirurgie et bien d’autres domaines. La recherche en IA a connu une renaissance à la fin des années 1990.

Elle a connu une croissance exponentielle depuis lors. Tout s’est accéléré dès le milieu des années 2010. Grâce à une combinaison de facteurs, tels que l’augmentation de la puissance de calcul des ordinateurs, la disponibilité de grandes quantités de données pour l’apprentissage automatique, les avancées dans les algorithmes d’apprentissage en profondeur et l’essor de la technologie de cloud computing. Cependant, il convient de noter que la recherche en IA a connu des périodes de progrès et de ralentissement tout au long de son histoire.

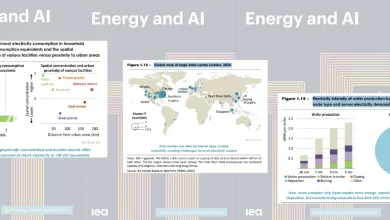

Figure N° 2 : Classement mondial dans le domaine de la gouvernance de l’intelligence artificielle. L’Algérie perd 12 places en 2022. Elle en avait gagné 42 d’un coup en 2021[11].

Les grands modèles de langages ou LLM

Tout le monde est habitué au confort que nous avons en tapant du texte sur nos claviers de smartphone ou ordinateur et que ces derniers pré-tapent, souvent en grisé, la suite d’un mot ou d’une expression, à notre place ou ces corrections automatiques de mots qui nous font très souvent tressautées ou sourire. Cela fait désormais partie de notre vie d’hyperconnecté.

C’est ce principe simple que nous connaissons et utilisons tous, sur lequel est basé le fonctionnement de GPT ainsi que tous les autres modèles de langages connus (Fig. N°3). Ce sont des modèles d’apprentissage automatique qui sont utilisés pour prédire la probabilité de la prochaine séquence de mots dans un texte et la générer.

Les LLM, ou Modèles de Langage à Grande Échelle, sont des systèmes d’intelligence artificielle conçus pour comprendre et produire du texte. Ils apprennent à partir de grandes quantités de données pour mieux saisir les règles et les subtilités de la langue. Ces modèles peuvent répondre aux questions, écrire des textes et dialoguer avec les utilisateurs de manière fluide et cohérente.

Le programme informatique GPT de la compagnie OpenAi[12], dont il est surtout question ici, est un grand modèle de langage, en Anglais Large language model (LLM). C’est un programme informatique qui peut comprendre ce que les gens écrivent ou disent et prédire ce qu’ils pourraient dire suite à cela. Il génère des phrases et du texte (Generative) parce qu’il entraîne sur une masse astronomique de données (Pre-trained) ce qui lui permet de les transformer (Transformer) en quelque chose de cohérent[13].

Figure N° 3 : Les différents grands modèles de langages dans le monde

ChatGPT

ChatGPT, en revanche, est une application spécifique basée sur les modèles GPT. ChatGPT est conçu pour interagir avec les utilisateurs en langage naturel, en fournissant des réponses et en ayant des conversations cohérentes. Il s’agit essentiellement d’un chatbot[14] intelligent qui utilise la puissance des modèles GPT pour comprendre et répondre aux requêtes des utilisateurs.

C’est ainsi que la version gratuite GPT-3.5 analyse déjà un grand nombre de textes pour apprendre la probabilité qu’un mot apparaisse dans un certain contexte. Il utilise pour cela 175 milliards de paramètres, qui sont des instructions spéciales qui aident l’ordinateur à comprendre et à prédire le langage humain.

C’est quoi un paramètre pour l’IA?

Imaginons que GPT soit un apprenti cuisinier qui apprend à préparer de nombreux plats différents. Les paramètres sont comme les ingrédients et les techniques de cuisson que l’apprenti doit maîtriser pour réussir chaque plat.

Lorsque GPT étudie d’énormes quantités de textes, il apprend à ajuster ces « ingrédients » et « techniques de cuisson » (paramètres) pour mieux comprendre et reproduire les structures et les nuances du langage humain. Plus il y a de paramètres, plus GPT peut saisir les détails subtils du langage, ce qui lui permet de générer des réponses plus précises et cohérentes.

Ainsi, les milliards de paramètres sont comme des milliards d’ingrédients et de techniques que GPT doit apprendre pour maîtriser le « plat » du langage humain. En ajustant et en affinant ces paramètres, le modèle devient plus compétent pour comprendre et imiter notre façon de communiquer.

Tous les paramètres ont été générés automatiquement par l’ordinateur lors de l’entraînement du modèle, car il serait trop difficile pour les humains de les créer manuellement. Ils sont un peu comme des briques de construction qui lui permettent de comprendre les mots, les phrases et le contexte.

Qu’est ce que ne peut pas faire ChatGPT?

ChatGPT en plus d’être un chatbot est un agent conversationnel et un agent personnel comme il en existe de plusieurs types depuis longtemps. ChatGPT peut écrire et aider à écrire des textes, répondre à des questions ou fournir des informations sur tout ou presque. C’est comme un artiste intelligent qui apprend en observant des exemples et crée ensuite de nouvelles choses à partir de ce qu’il a appris. Il peut créer du texte, des images, de la musique ou des vidéos en s’inspirant de ce qu’il a vu auparavant, mais en produisant quelque chose d’unique et de différent. Nous verrons plus bas que GPT-4 s’en approche encore beaucoup plus, surtout en ce qui concerne les images et les vidéos ce qui n’est pas capable de faire la version 3.5.

C’est ainsi que ChatGPT[15] peut, en un tour de main, compléter un email ou une lettre, répondre à une question posée sur un site Web ou même générer des idées créatives pour un projet. C’est un rédacteur et un créateur de contenu hors pair. Il peut rédiger une poésie ou une prose, écrire des nouvelles ou des histoires courtes sur des sujets variés.

Il peut tout aussi bien rédiger des articles de blog sur des sujets d’intérêt général, des conseils, des opinions ou des critiques. Il est capable de préparer des discours pour une occasion spéciale, comme une remise de prix ou une présentation professionnelle.

Il est tout aussi à l’aise pour rédiger des rapports et des essais académiques avec un texte structuré et argumenté comme tout travail universitaire ou de recherche. Il peut aisément préparer des Curriculum Vitae professionnels pour mettre en valeur les compétences et expériences professionnelles et rédiger des lettres de motivation.

Il peut alimenter les réseaux sociaux (Facebook, Twitter, Instagram, etc…) avec du contenu de qualité ou préparer des synopsis et des pitchs pour présenter un projet créatif ou entrepreneurial. Comme il est aussi capable de préparer et rédiger des documents didactiques pour enseigner une compétence ou un processus ou enfin écrire des biographies en racontant l’histoire d’une vie ou celle d’une personne inspirante. En fait, on devrait plutôt se demander qu’est qu’il ne peut pas faire?

ChatGPT-4

GPT-3.5 a dernièrement évolué vers une version 4 plus avancée. GPT-4 aurait plus d’un trillion de paramètres[16] soit plus de 500 fois plus que GPT-3.5. Alors que cette dernière est toujours disponible et gratuite, GPT-4 est par contre payante.

La différence essentielle entre GPT-3.5 et GPT-4 réside dans la taille de leurs modèles respectifs et dans leurs données d’entraînement. Le modèle GPT-4 est beaucoup plus grand, ce qui signifie qu’il peut traiter des tâches plus complexes et générer des réponses plus précises. Cela est dû à un ensemble de données d’entraînement plus étendu, qui lui donne une base de connaissances plus large et une meilleure compréhension du contexte.

Grâce à chatGPT, l’IA va forcément être encore plus présente dans notre vie quotidienne. Les chatbots, les assistants vocaux et les agents conversationnels basés sur l’IA seront de plus en plus courants et naturellement installés dans toutes les unités connectées qui nous entourent, offrant une expérience utilisateur plus personnalisée et plus conviviale……

A SUIVRE

[1] Le mouvement luddite tire son nom d’un homme appelé Ned Ludd, qui aurait été le premier à casser un métier à tisser automatique en 1779. Les luddites ont mené des attaques contre les usines et les machines en Angleterre de 1811 à 1817, mais leur mouvement a été réprimé par les autorités et la violence a finalement cessé.

[2] Le régulateur italien reproche à OpenAI plusieurs manquements au RGPD. Entre autres, le fait que l’application ne nécessite pas de faire vérifier son âge. OpenAi a répondu qu’il y travaillait et appliquera les règles adéquates.

[3] Depuis la victoire de Deep Blue contre Garry Kasparov, aucun joueur d’échecs humain n’a réussi à battre un programme d’échecs de niveau mondial lors d’une compétition régulière.

[4] Muḥammad ibn Mūsā al-Khwārizmī (en arabe : محمد بن موسى الخوارزمي), généralement appelé Al-Khwârizmîn (latinisé en Algoritmi ou Algorizmi), né dans les années 780, probablement à Khiva dans la région du Khwarezm (d’où il prend son nom), dans l’actuel Ouzbékistann, mort vers 850 à Bagdad, est un mathématicien, géographe, astrologue et astronome persan.

[5] Al-Jazari (1136-1206) était un ingénieur et un inventeur célèbre de son temps, connu pour ses machines sophistiquées, telles que des horloges astronomiques, des fontaines animées et des automates. Son livre « The Book of Knowledge of Ingenious Mechanical Devices » est considéré comme un chef-d’œuvre de la littérature technique. Ses contributions ont influencé le développement ultérieur de la robotique et de l’automatisation.

[6] Enigma est une machine électromécanique portative servant au chiffrement et au déchiffrement de l’information. Elle fut inventée par l’Allemand Arthur Scherbius, reprenant un brevet du Néerlandais Hugo Koch, datant de 1919. Elle fut utilisée principalement par l’Allemagne nazie pendant la Seconde Guerre mondiale.

[7] Il y a eu deux hivers de l’IA. Le premier a eu lieu dans les années 1970 et le début des années 1980, et le second a eu lieu dans les années 1990. Ces périodes ont été marquées par des avancées insuffisantes et par une baisse des financements, ce qui a entraîné une stagnation de la recherche en intelligence artificielle.

[8] Un système expert est un outil informatique qui peut imiter le fonctionnement du cerveau d’un expert dans un domaine spécifique. C’est l’une des façons de créer une intelligence artificielle.

[9] L’apprentissage profond est une méthode d’apprentissage automatique qui utilise des réseaux neuronaux profonds pour résoudre des problèmes complexes, comme la reconnaissance d’images ou la traduction automatique. Cela permet d’obtenir des résultats plus précis et de nombreuses industries l’utilisent pour améliorer leurs services et produits.

[10] Les réseaux neuronaux sont une méthode informatique qui imite le fonctionnement du cerveau humain pour résoudre des problèmes complexes, comme la reconnaissance d’images ou la prédiction de résultats.

[11] L’Algérie a lancé en 2020, une stratégie nationale en intelligence artificielle. https://drive.google.com/file/d/1UEPqOoa4fc1lRdox4AQZAzOPxp0AFKwM/view?usp=sharing

[12] L’entreprise OpenAI est dirigée par un conseil d’administration composé de personnalités de divers horizons, notamment des experts en intelligence artificielle, des entrepreneurs, des dirigeants d’entreprises et des universitaires. Parmi les membres du conseil d’administration figurent notamment Elon Musk, Sam Altman, Greg Brockman, Reid Hoffman, Shivon Zilis, Ilya Sutskever et Dario Amodei.

[13] L’intelligence artificielle (IA) générative est un type d’IA qui crée de nouvelles données ou contenus en se basant sur les informations existantes. Les IA génératives sont souvent utilisées pour stimuler la créativité, automatiser la création de contenu ou concevoir de nouvelles solutions pour des problèmes complexes.

[14] Mot anglais, de chat, bavardage, et bot, robot

[15] Un chatbot est un programme informatique conçu pour simuler une conversation avec un utilisateur humain. Il est capable de comprendre et de répondre aux messages textuels ou vocaux en utilisant un langage naturel. Ils sont généralement intégrés dans des plateformes de messagerie, des sites Web ou des applications mobiles pour faciliter la communication et l’interaction avec les utilisateurs.

[16] Le nombre de paramètres de GPT-4 n’est pas encore officiellement. A cette date, les rumeurs vont de 1 à 170 trillions.

2 commentaires